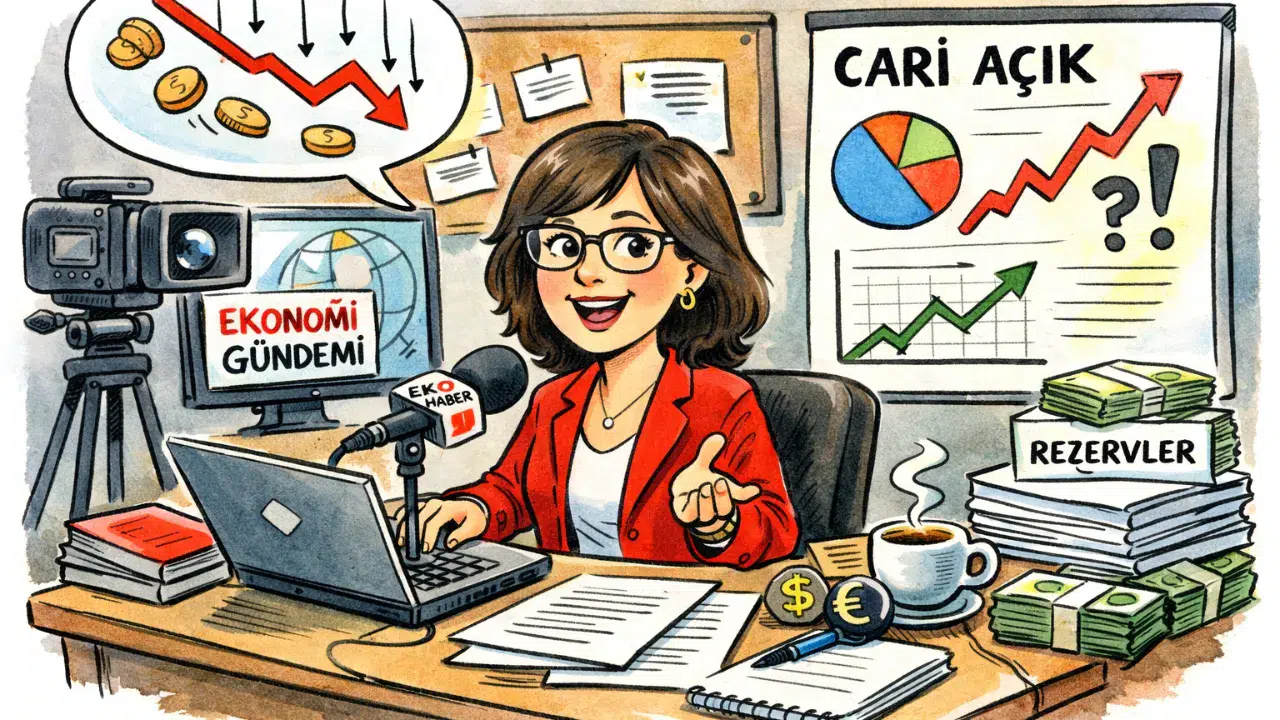

Yapay zekâ ile üretilen karikatürler, son zamanlarda sosyal medya platformlarında hızla yayılarak dikkat çekmektedir. Bu durum, uzmanların yüklenen fotoğrafların dolandırıcılık ve kimlik taklidi riskini artırabileceği yönündeki uyarılarını gündeme getirmektedir. Yüksek çözünürlüklü bir görselin kişisel verilerle birleşmesi, ciddi güvenlik açıklarına yol açabilmektedir.

Son dönemde yapay zekâ ile oluşturulan görsellerin sosyal medya üzerinde artış göstermesi, kullanıcıların bu platformlarda daha fazla etkileşimde bulunmasına neden olmaktadır. Ancak, bu durum yapay zekâ sohbet botlarına yüklenen görsellerle ilgili endişelerin de artmasına yol açmaktadır. Görsellerin ne kadar süre saklandığı belirsizliğini korurken, olası bir hacklenme durumunda kötü niyetli kişilerin bu verilere ulaşmasının birçok suistimale yol açabileceği ifade edilmektedir.

Yapay zekâ karikatürleri neden risk taşıyor?

Son günlerde popüler hale gelen yapay zekâ karikatür modası, siber güvenlik uzmanları tarafından ciddi güvenlik riskleri oluşturduğu konusunda uyarılara neden olmuştur. Kullanıcılar, şirket logoları ya da kişisel detaylar içeren fotoğraflarını yükleyerek, OpenAI'nin ChatGPT'sinden kendileri hakkında bilgi toplayarak karikatür oluşturmalarını istemektedirler. Bu süreçte, kullanıcıların farkında olmadan dolandırıcılar için değerli bilgiler sağladıkları belirtilmektedir.

Siber güvenlik uzmanları, bu tür sosyal medya akımlarının dolandırıcılara önemli ölçüde bilgi sunduğunu ve tek bir görselin kişisel ayrıntılarla birleştiğinde kullanıcıların bilmediği birçok bilgiyi açığa çıkarabileceğini vurgulamaktadır. Daon şirketinin başkan yardımcısı Bob Long, kullanıcıların aslında dolandırıcıların işini kolaylaştırdığını ve onlara kimliklerinin görsel bir temsilini sunduklarını ifade etmektedir.

Görsel yükleme süreci nasıl işliyor?

Bir kullanıcı, yapay zekâ sohbet botuna bir görsel yüklediğinde, bu sistemin kişinin duygusal durumu, bulunduğu ortam ya da konum bilgileri gibi verileri işlemek için o görseli analiz ettiğini belirten siber güvenlik danışmanı Jake Moore, bu bilgilerin ne kadar süreyle saklanacağının belirsiz olduğunu vurgulamaktadır. Long, yüklenen görsellerin yapay zekâ görüntü üreticilerini eğitmek için veri setlerinin bir parçası olarak kullanılabileceğini ve bu bilgilerin elde tutulabileceğini ifade etmektedir.

OpenAI gibi bir şirkette yaşanabilecek bir veri ihlali, yüklenen görsellerin ve sohbet botunun topladığı kişisel verilerin kötü niyetli kişilerin eline geçmesine yol açabilecektir. Check Point'in kurumsal çözümler birimi başkanı Charlotte Wilson, yanlış ellere geçtiğinde tek bir yüksek çözünürlüklü fotoğrafın sahte sosyal medya hesapları ya da dolandırıcılıkta kullanılabilecek gerçeğe çok yakın yapay zekâ temelli “deepfake”ler oluşturmak için kullanılabileceğini belirtmektedir.

Trende katılmak isteyenler ne yapmalı?

Yapay zekâ ile üretilen karikatür trendini denemek isteyen kullanıcılara uzmanlar, paylaştıkları bilgileri olabildiğince sınırlamalarını önermektedir. Wilson, kimlik tespitine yarayabilecek bilgiler içeren fotoğraflar yüklemekten kaçınılması gerektiğini vurgularken, fotoğrafların dikkatlice kırpılması ve arka planın sade tutulması gerektiğini belirtmektedir. Ayrıca, iş unvanı, yaşadığı şehir ya da işverenin adı gibi kişisel bilgilerin komutlara gereğinden fazla dahil edilmemesi gerektiği konusunda uyarılarda bulunmaktadır.

Moore, kullanıcıların gizlilik ayarlarını gözden geçirmelerini ve verilerin yapay zekâ eğitiminden çıkarılmasına yönelik seçenekleri değerlendirmelerini tavsiye etmektedir. OpenAI’nin gizlilik portalında kullanıcılar, içeriklerinin yapay zekâ eğitiminde kullanılmasını reddetmek için “do not train on my content” seçeneğine tıklayabilirler. Ayrıca, kullanıcılar ChatGPT ile yaptıkları yazılı sohbetlerin eğitimde kullanılmasını engellemek için “improve the model for everyone” ayarını kapatabilirler. Avrupa Birliği yasalarına göre kullanıcılar, şirketin topladığı kişisel verilerinin silinmesini talep edebilirken, OpenAI, dolandırıcılık ve güvenlik kaygılarını gidermek amacıyla bazı bilgileri saklayabileceğini belirtmektedir.